EchoLeak攻擊引爆AI資安新危機 資策會科法所:借鏡歐盟強化數位防禦體系

(中央社訊息服務20260226 18:17:19)隨著人工智慧技術演進為具備自主執行能力的「代理人」(Agentic AI),企業面臨的資安邊界已發生質變,2025年初發生的「EchoLeak」攻擊事件,重新定義企業對AI安全的認知。面對此類「AI武器化」風險,歐盟已於2024年通過《人工智慧法》(AI Act),並搭配2025年發布的實踐準則,建立強制性預防體系。

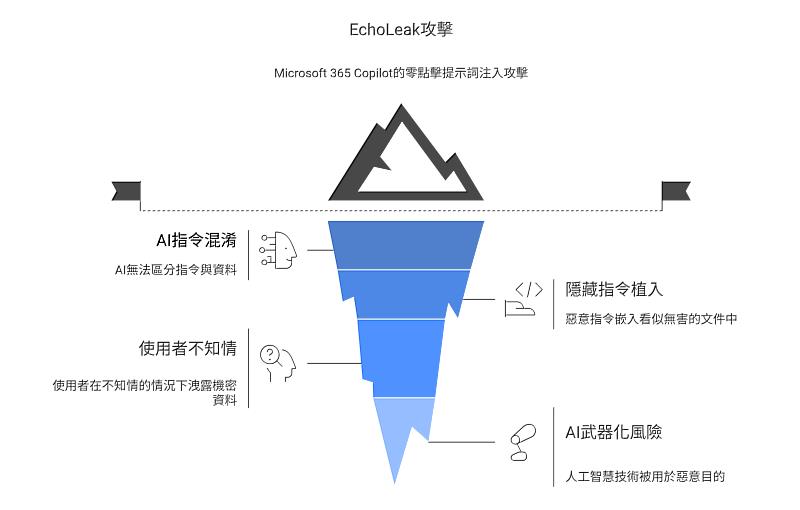

「EchoLeak」攻擊事件係針對Microsoft 365 Copilot進行「零點擊」(Zero-Click)的提示詞注入(Prompt Injection)攻擊,攻擊者將隱藏指令植入看似無害的文件中,誘使AI自動檢索薪資單等敏感資料並回傳,顯示AI系統缺乏分辨「指令」與「資料」的能力,使用者在完全不知情的情況下,僅因AI助手「盡職」地處理文件,便導致機密外洩。

財團法人資訊工業策進會科技法律研究所(資策會科法所)觀測發現,歐盟於2024年通過《人工智慧法》(Artificial Intelligence Act),並於2025年8月全面生效,其中第55條特別針對「具系統性風險的通用AI模型」(GPAI models with systemic risk),要求AI模型提供者應於模型釋出前,便能證明其具備抵禦攻擊的能力,包含在部署前必須進行風險評估與「對抗性測試/紅隊演練」(Adversarial Testing/Red Teaming),並建立能保護模型及實體基礎設施的資安防護措施;如有發生涉及嚴重資安事故,必須向歐盟新成立的「AI辦公室」(AI Office)通報。

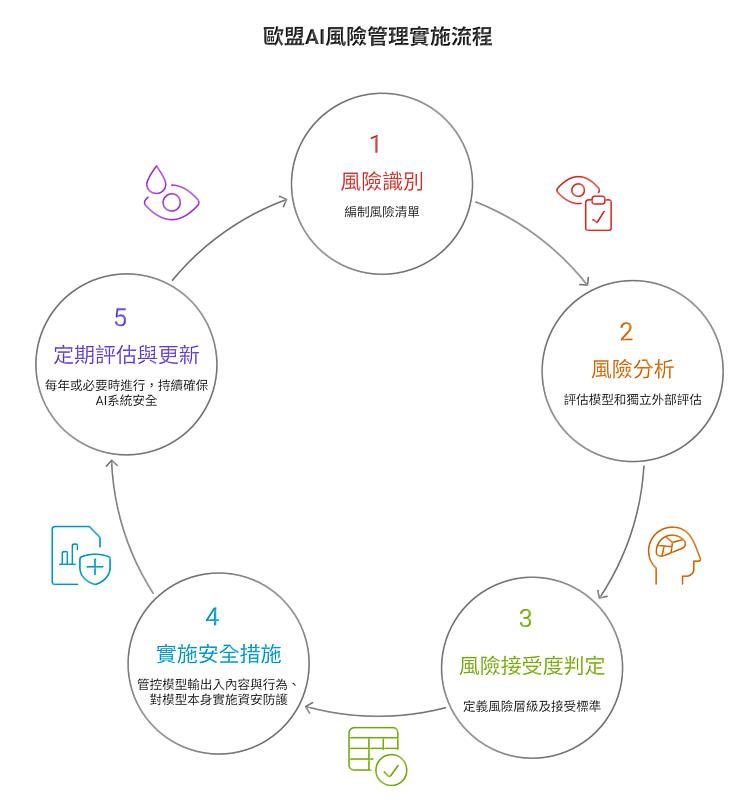

為協助企業自主落實法規義務,歐盟AI辦公室於2025年7月發布「通用AI實踐準則」(Code of Practice for GPAI),在安全性章節中,企業需針對AI模型建立完整的「安全性框架」(Safety and Security Framework, SSF),涵蓋具體的風險評估流程與緩解措施,並在其生命週期內實施適當的安全措施,包含:管控模型輸出入內容與行為(如過濾惡意提示詞、訓練模型拒絕執行有害指令等);對模型本身實施資安防護措施(如存取管理、定期軟體更新與漏洞修補等),以防止訓練資料被汙染或模型遭受破壞等。

台灣立法院2025年12月三讀通過《人工智慧基本法》,其中第4條明確揭示包含「資安與安全」在內的七大發展原則,要求企業建立資安防護措施。資策會科法所建議,台灣宜借鏡歐盟經驗,將具體的資安防禦要求納入基本法配套規範。針對被歸類為「高風險」或具「系統性風險」的AI系統,應要求企業在AI開發階段即導入「安全設計」(Safety by Design)思維。此外,政府可透過採購規範或評測機制,引導產業建立「AI防火牆」,在指令進入模型前即進行識別與攔截,落實主動防禦。資策會科法所將持續觀測國際AI資安治理法規動態,汲取他國執法經驗,協助台灣產業在享受AI價值的同時,構築具韌性的數位護城河。